El gobierno del Reino Unido ha firmado el primer tratado internacional sobre inteligencia artificial en una medida que pretende prevenir usos indebidos de la tecnología, como la difusión de información errónea o el uso de datos sesgados para tomar decisiones.

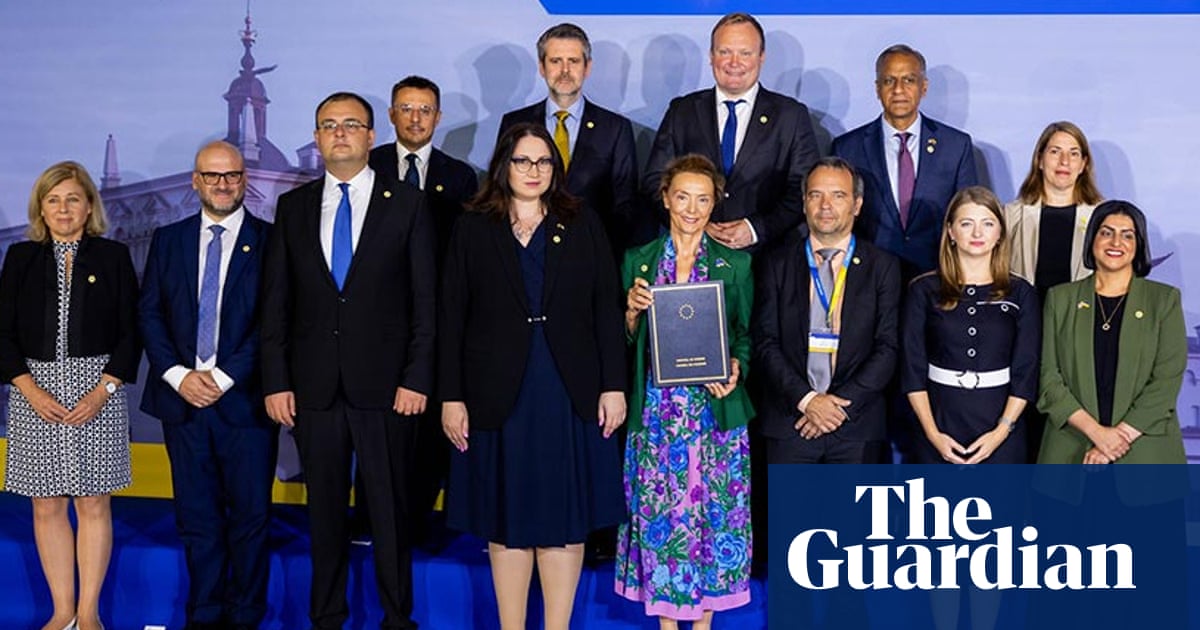

En virtud del acuerdo jurídicamente vinculante, los Estados deben implementar salvaguardas contra cualquier amenaza que la IA plantee a los derechos humanos, la democracia y el estado de derecho. El tratado, llamado Convención Marco sobre Inteligencia Artificial, fue elaborado por la Consejo de Europauna organización internacional de derechos humanos, y fue firmado el jueves por la UE, el Reino Unido, Estados Unidos e Israel.

La secretaria de Justicia, Shabana Mahmood, dijo que AI tenía la capacidad de “mejorar radicalmente” los servicios públicos y “acelerar” el crecimiento económico, pero que debía adoptarse sin afectar los derechos humanos básicos.

“Esta convención es un paso importante para garantizar que estas nuevas tecnologías puedan aprovecharse sin erosionar nuestros valores más antiguos, como los derechos humanos y el estado de derecho”, dijo.

A continuación se presenta un resumen de la convención y su impacto en el uso de la IA.

¿Cuál es el objetivo de la convención?

Según el Consejo de EuropaSu objetivo es “llenar cualquier vacío legal que pueda resultar de los rápidos avances tecnológicos”. Los recientes avances en IA (el término que designa a los sistemas informáticos que pueden realizar tareas típicamente asociadas con seres inteligentes, como el aprendizaje y la resolución de problemas) han desencadenado una lucha regulatoria en todo el mundo para mitigar los posibles defectos de la tecnología.

Esto significa que existe un mosaico de regulaciones y acuerdos que cubren la tecnología, desde la Ley de inteligencia artificial de la UE Al año pasado Declaración de Bletchley en la cumbre inaugural mundial sobre seguridad de la IA, y una régimen de pruebas voluntarias El acuerdo, firmado por numerosos países y empresas en la misma reunión, es un intento de crear un marco global.

El tratado establece que los sistemas de IA deben cumplir con un conjunto de principios, entre ellos: la protección de los datos personales, la no discriminación, el desarrollo seguro y la dignidad humana. Como resultado, se espera que los gobiernos introduzcan salvaguardas, como la de frenar la desinformación generada por la IA y evitar que los sistemas se entrenen con datos sesgados, lo que podría dar lugar a decisiones erróneas en diversas situaciones, como las solicitudes de empleo o de prestaciones.

¿Quién está cubierto por el tratado?

Abarca el uso de la IA por parte de las autoridades públicas y el sector privado. Toda empresa u organismo que utilice sistemas de IA pertinentes debe evaluar su posible impacto en los derechos humanos, la democracia y el Estado de derecho, y poner esa información a disposición del público. Las personas deben poder impugnar las decisiones adoptadas por los sistemas de IA y presentar quejas ante las autoridades. Los usuarios de los sistemas de IA también deben saber que están tratando con una IA y no con un ser humano.

¿Cómo se implementará en el Reino Unido?

El Reino Unido necesita ahora comprobar si sus diversas disposiciones están contempladas en la legislación vigente, como la del Tribunal Europeo de Derechos Humanos y otras leyes de derechos humanos. El gobierno está preparando una consulta sobre un nuevo proyecto de ley de inteligencia artificial.

“Una vez que el tratado sea ratificado y entre en vigor en el Reino Unido, se mejorarán las leyes y medidas existentes”, dijo el gobierno.

En cuanto a la imposición de sanciones, la convención prevé que las autoridades puedan prohibir determinados usos de la IA. Por ejemplo, la Ley de IA de la UE prohíbe los sistemas que utilizan bases de datos de reconocimiento facial extraídas de cámaras de vigilancia o de Internet. También prohíbe los sistemas que categorizan a los humanos en función de su comportamiento social.