Pocas cosas despiertan más mi escepticismo que cuando una empresa empieza a hablar de cómo va a integrar la IA en sus productos. Dado que la inteligencia artificial se ha convertido en la última moda, muchos anuncios y demostraciones de IA parecen tener un tufillo a “ah, sí, nosotros también”, independientemente de si esos anuncios o demostraciones tienen algún valor real o no.

Esto se ha convertido en un riesgo laboral para quienes escribimos sobre teléfonos para ganarnos la vida, ya que parece que hoy en día no se puede lanzar un teléfono sin enumerar una larga lista de capacidades de inteligencia artificial, muchas de las cuales son trucos de fiesta glorificados que aportan poco valor duradero a cualquiera que realmente use el teléfono.

Entonces, cuando la semana pasada Evento creado por Google Comenzó con una discusión de su Modelo de IA de Gemini Y lo que esto significa para los dispositivos móviles, podía sentir que mi cerebro organizaba activamente una huelga de brazos caídos. “Aquí vamos de nuevo”, me encontré pensando, mientras me preparaba para un montón de funciones que lucían bien en una demostración, pero que tenían muy poca utilidad práctica.

Para mi sorpresa, cuando finalizó el evento y tuve la oportunidad de ver demostraciones adicionales de cerca, quedé bastante impresionado por lo que Google está haciendo con Gemini y lo que significa para dispositivos como el Modelos de Pixel 9 que saldrán a la venta a finales de esta semana. Si bien todavía tengo mis dudas sobre la promesa general de la IA en los dispositivos móviles, tendría que ser bastante testarudo para no admitir que muchas de las características de Gemini te ayudarán a hacer mucho más con tu teléfono inteligente de maneras que habrían parecido inimaginables no hace mucho tiempo.

Pasando a la multimodalidad

Gemini es multimodal, incluso cuando está en un dispositivo móvil. Eso significa que es capaz de reconocer más que solo indicaciones de texto: puede ver imágenes, códigos y videos, y extraer información de esas fuentes también. Y eso ayuda al asistente con tecnología Gemini en los dispositivos Pixel a hacer algunas cosas bastante impresionantes.

Por ejemplo, en una demostración, una mujer pudo usar un recordatorio escrito a mano sobre la fecha de envío del Pixel 9, el 22 de agosto, para que Gemini creara una tarea que le recordara que debía reservar el teléfono y, al mismo tiempo, agregar esa fecha a su calendario. Sí, podrías hacer esas cosas tú mismo sin la intervención de un asistente digital. Pero eso significaría dejar de lado lo que estés haciendo para iniciar un mínimo de dos aplicaciones para poder ingresar manualmente tus recordatorios y eventos. Gemini se encarga de eso sin interrumpir tu flujo.

Otra demostración del evento Made By Google le encargó a Gemini que observara una YouTube video sobre restaurantes coreanos y luego hacer una lista de los alimentos individuales en una aplicación de notas. Como alguien que ve muchos videos de cocina, aprecio cómo esto me puede ahorrar tiempo: en lugar de tener que anotar los ingredientes o los pasos de preparación yo mismo, lo que inevitablemente significa volver al video para asegurarme de que no me he perdido nada, puedo poner a Gemini a trabajar. Eso me libera para concentrarme en el contenido del video, sabiendo que habrá un registro digerible esperándome cuando termine de verlo.

IA que es útil

Estos ejemplos resuenan porque muestran formas en que la IA puede ahorrarle tiempo al quitarle de encima tareas tediosas. Donde los fabricantes de dispositivos se equivocan es cuando trasladan ese espíritu de ahorro de tiempo a tareas que requieren más creatividad. Google, con su Anuncio de los Juegos Olímpicos muy difamado con correos de fans generados por IA, no es ajeno a este paso en falso.

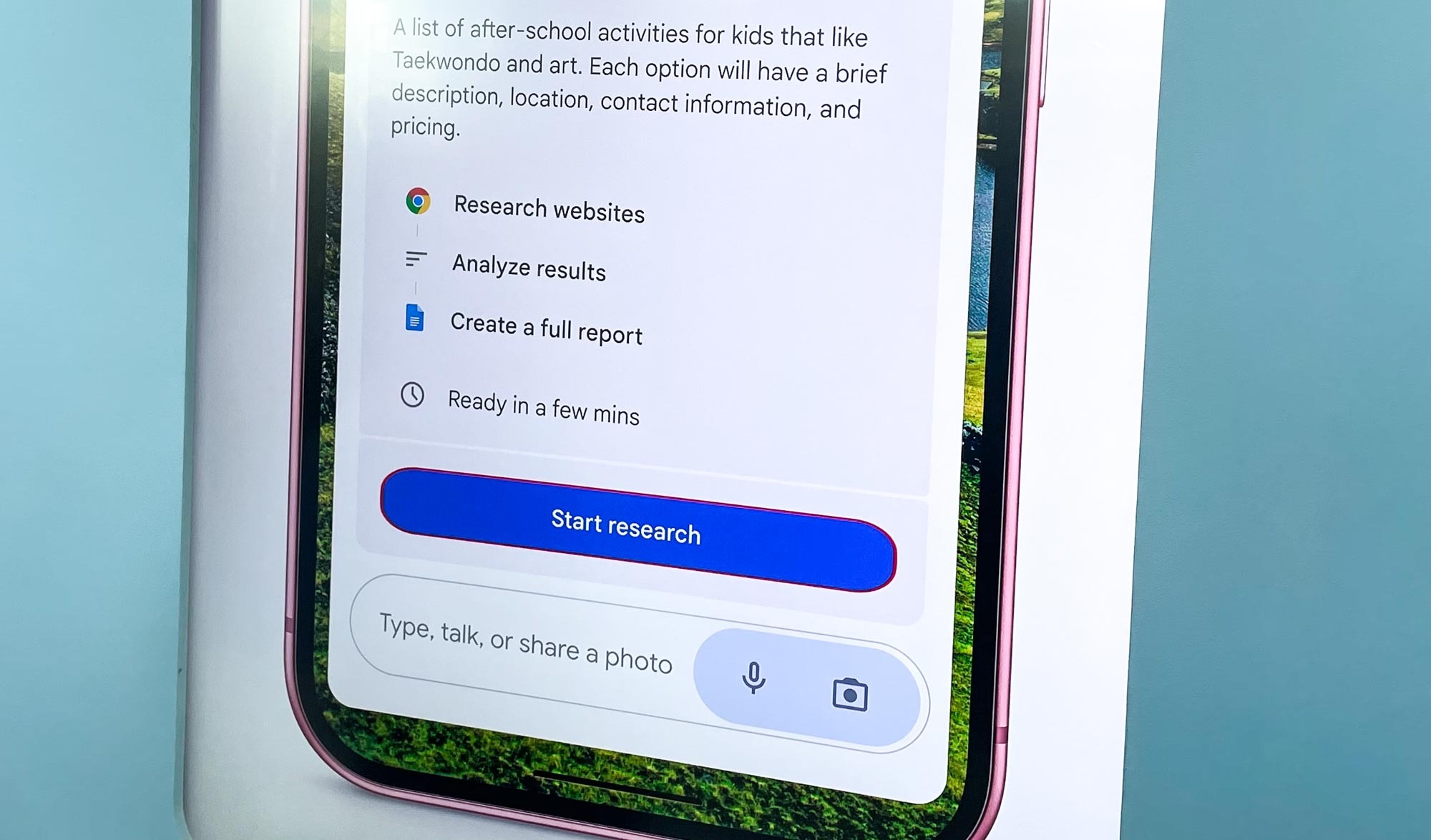

Dejando de lado esos errores, parece que Google realmente entiende que Gemini funcionará mejor cuando elimine los obstáculos que te impiden hacer las cosas. Por ejemplo, las funciones de Gemini con investigación que Google planea agregar a Gemini Advanced en los próximos meses. Con esa función de investigación, podrás encargarle a Gemini que busque información específica en línea. En la demostración que vi, Gemini se puso a trabajar en la investigación de programas extraescolares para niños interesados en las artes marciales.

Antes de comenzar, Gemini with Research mostrará un plan de acción que enumera lo que pretende buscar para que usted lo revise y modifique. Luego, explorará los rincones más remotos de la web y buscará información relacionada que puede incluir en un informe que se pone a su disposición a través de Google Docs. Incluso obtendrá enlaces dentro de ese informe a las fuentes en línea que Gemini ha encontrado.

Es un método bastante atractivo para la investigación en línea, en particular porque Gemini probablemente pueda trabajar más rápido y con más profundidad que yo a la hora de reunir información. Pero la IA no me deja totalmente al margen: puedo ajustar el plan de investigación haciendo sugerencias sobre qué buscar y puedo rastrear la información obtenida para asegurarme de que se ajuste a mis criterios. En lugar de delegarle una tarea completa a Gemini, dejo que se encargue del trabajo pesado, de modo que, en última instancia, pueda tomar decisiones informadas.

Alguien con quien puedas hablar

También agradezco la Géminis en vivo característica mostrada en Made by Google y Implementación para suscriptores de Gemini Advanced mientras hablamos. Este es el componente de voz del chatbot de Google y está diseñado para sonar natural y conversacional: música para los oídos de aquellos de nosotros que hemos tenido dificultades para comunicarnos con asistentes de voz como Siri porque usamos la palabra equivocada o no aclaramos suficientemente el contexto.

Un aspecto potencialmente útil de Gemini Live es la capacidad de usar el asistente de voz como herramienta de lluvia de ideas. Puedes hacerle una pregunta a Gemini (por ejemplo, sobre cosas que hacer este fin de semana) y el asistente comenzará a sugerir ideas. Como puedes interrumpirlo en cualquier momento, puedes profundizar en una idea que suene prometedora. Además, Gemini entiende el contexto de la conversación, por lo que las preguntas pueden ser informales y espontáneas.

Google Gemini Live… las voces suenan supernaturales. Aquí te mostramos algunas de las opciones #MadeByGoogle pic.twitter.com/YJWGEuqSAX13 de agosto de 2024

Tendría que probar Gemini Live para convencerme de verdad, pero el aspecto conversacional es atractivo. Al igual que la capacidad de ajustar los parámetros en Gemini con Research, esto me parece un uso más colaborativo de la IA, donde el chatbot responde a tu entrada y refina la información presentada según tus especificaciones.

Perspectiva de Géminis

Todavía tengo algunas dudas sobre la IA en los teléfonos en general y en Gemini en particular. Funciones como la generación de imágenes simplemente no me interesan, y siempre existe el riesgo de que un usuario especialmente perezoso o poco ético pueda tomar el resultado de algo como Gemini with Research y hacerlo pasar como propio. Y, por supuesto, todos debemos estar atentos para que se mantengan las salvaguardas de privacidad prometidas.

Pero si mi queja general sobre las funciones de inteligencia artificial en los teléfonos es que muchas de ellas parecen trucos de fiesta glorificados, ese no es ciertamente el caso de lo que vi hacer a Gemini esta semana. Google claramente está creando una herramienta que te ayuda a hacer aún más con tu teléfono. Y esa es razón suficiente para estar entusiasmado con las posibilidades.